本文简单介绍 MICRO 模型

- 参考链接:

MICRO 基本思想

- 主要用于解决Offline RL的问题,属于Model-based方法

- 发表于2023年底,中IJCAI 2024

MICRO 方法详情

- MICRO训练代码

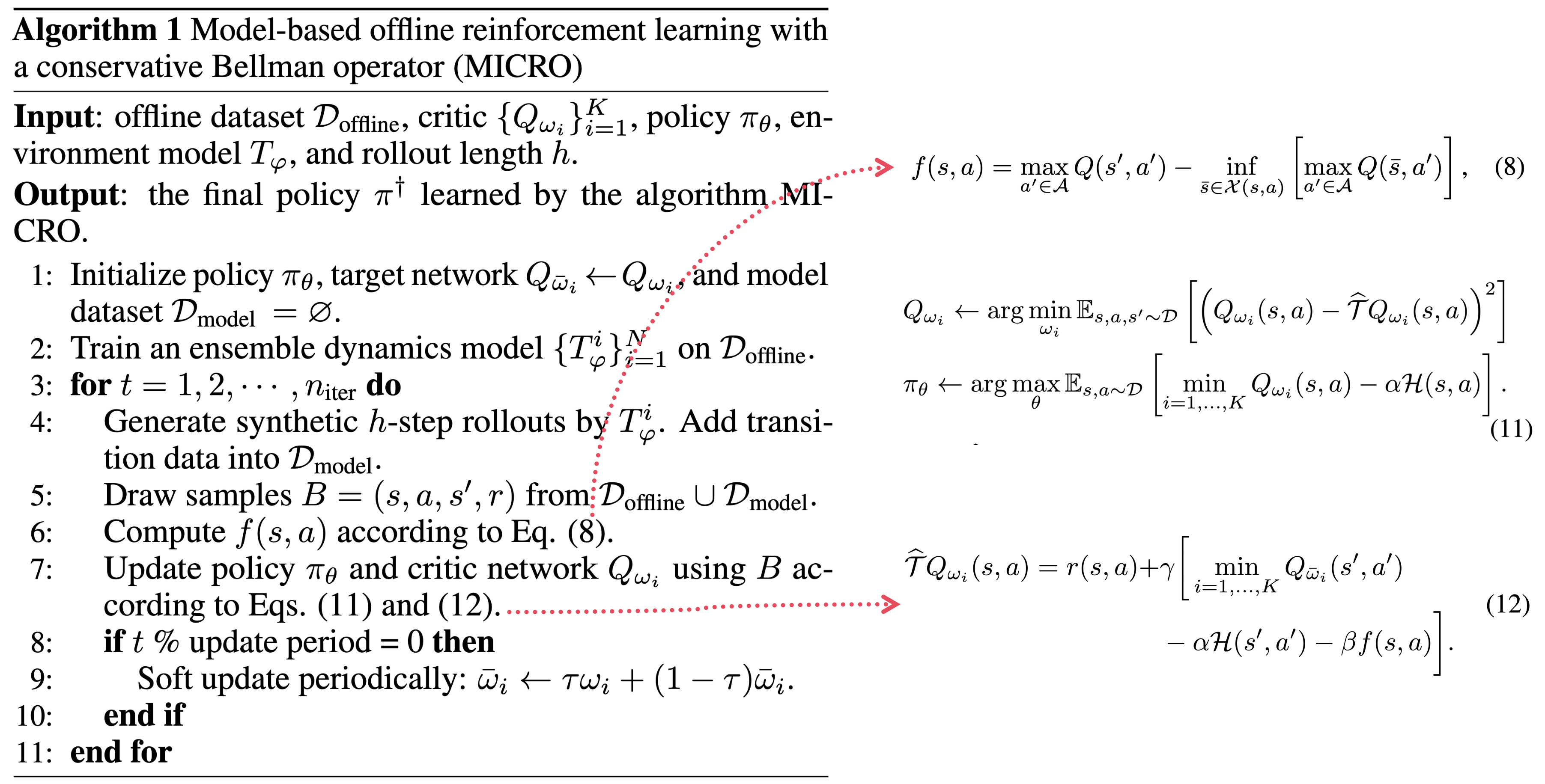

- 流程说明:

- 训练 K 个Critic网络 \(\{Q_{w_i}\}_{i=1}^K\) ,类似 Twin Q 的作用

- 训练 N 个Dynamics模型 \(\{T_\phi^i\}_{i=1}^N\) ,用于交互合成数据

- 每次迭代时:

- 从 \(T_\phi^i\) 中采样得到多步展开,并加入到数据集 \(D_\text{model}\) 中

- 从混合数据(模型和真实数据混合)中采样

- 按照指定公式分别更新 Critic 网络和策略网络

- 软更新目标Q网络

- 相关变量说明:

- 关于公式:\(f(s,a) = \max_{a’\in \mathcal{A}}Q(s’,a’) - \inf_{\bar{s} \in \mathcal{X}(s,a)}\Big[ \max_{a’\in \mathcal{A}}Q(\bar{s},a’) \Big]\) ,有:

$$

\begin{align}

s’ &\sim \frac{1}{N}\sum_{i=1}^N T_\phi^i(s’|s,a) \\

\mathcal{X}(s,a) &= \{s’|s’\sim T_\phi^i(s’|s,a), i=1,2,\cdots,N \}

\end{align}

$$- 这里使用 \(\inf_{\bar{s} \in \mathcal{X}(s,a)}\Big[ \max_{a’\in \mathcal{A}}Q(\bar{s},a’) \Big]\) 可以用于减少状态 \(s’\) 的不确定性对Q值造成的影响,Model-based RL自动出价算法的演进之路,阿里妈妈技术中有用到类似思想

- 关于公式:\(f(s,a) = \max_{a’\in \mathcal{A}}Q(s’,a’) - \inf_{\bar{s} \in \mathcal{X}(s,a)}\Big[ \max_{a’\in \mathcal{A}}Q(\bar{s},a’) \Big]\) ,有:

- 问题:

- 如何理解公式12中 \(f(s,a)\) 的作用?